“Zeg eens eerlijk? Wat is nu je grootste angst bij algoritmes?” Als ik dit vraag aan mensen is het antwoord vaak: “Algoritmes discrimineren!”. En natuurlijk: het is verre van gewenst om te discrimineren, maar hoe zorgen we ervoor dat algoritmes niet discrimineren?

Allereerst door te snappen dat algoritmes niet discrimineren. Wel kunnen algoritmes verkeerd worden ontwikkeld, zodat zij onterecht of ongewenst onderscheid maken. Dit heet in vaktermen ‘bias’. En eigenlijk is het eenvoudig: als je in het algoritme de ‘bias’ onder controle hebt, dan voorkom je ook discriminatie. In een serie van blogs zal ik uitleggen hoe je dit doet. We trappen af met het antwoord op de vraag: Wat is bias?

Wat is bias?

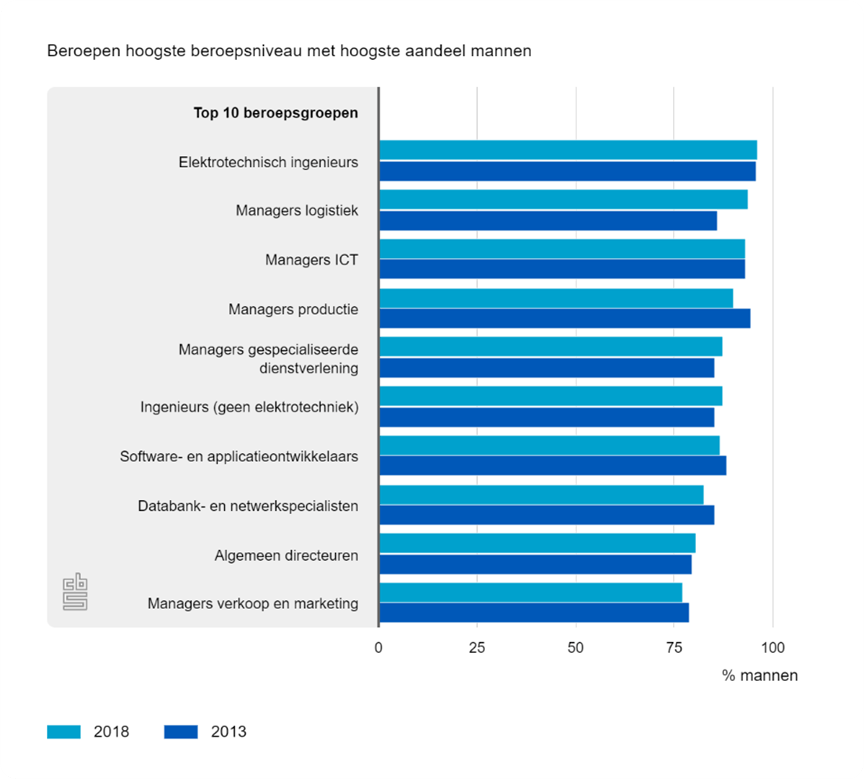

Discriminatie door een algoritme wordt door ontwerpers van algoritmes ‘bias’ genoemd. Maar bias betekent niets anders dan een systematisch verschil in representativiteit1. De verhouding tussen groepen (zoals man/vrouw, hoog/midden/laag of arm/rijk) is niet gelijk: niet elke groep vertegenwoordigt een even groot deel van het totaal. In de praktijk komt het bijvoorbeeld zelden voor dat alle inwoners van een gemeente of alle respondenten van een enquête dezelfde man/vrouw verhouding hebben als landelijk of in de wereld. Ongelijke verhoudingen zijn dus onvermijdelijk in de echte wereld. Daarmee is bias (in de interpretatie van ‘ongelijkheid’) dus op zichzelf niet vreemd of discriminerend. Zo is feitelijk te constateren dat veel vrouwen bevallen van een kind, maar discrimineert een vroedvrouw niet omdat ze alleen vrouwen bij hun bevalling assisteert. Ook kan feitelijk worden vastgesteld dat mannen over het algemeen geen (of in ieder geval: minder) jurken dragen. Discrimineer ik wanneer ik als kledingadviseur volgens de laatste mode een man een outfit met een broek presenteer? Het CBS2 stelt in 2019 vast dat de disproportie tussen mannen en vrouwen in beroepsgroepen onder andere samenhangt met hun studiekeuze. In de zorg en het onderwijs zijn vrouwen oververtegenwoordigd. In de andere beroepsgroepen vind je overwegend mannen, zie Figuur 1.

Figuur 1: Top 10 beroepsgroepen, bron: CBS, in een derde van beroepen op hoogste niveau is meerderheid vrouw (2019).

Ook al streeft een bedrijf naar de kwalitatief beste invulling van één van deze functies in de top 10 en heeft het bedrijf geen voorkeur voor een man, dan nog zal de man/vrouw-verhouding niet gelijk zijn onder de reacties op de sollicitaties. Dit betekent niet dat dit bedrijf met opzet discrimineert; vaak zijn het de onderliggende studiekeuzes waarin vrouwen ondervertegenwoordigd zijn.

Zo zijn er tal van voorbeelden waar we kunnen waarnemen dat de man/vrouw verhouding ongelijk is. Maar wanneer wordt deze ongelijkheid discriminatie? Wanneer tolereren we deze ‘discriminatie’ niet meer? En hoe leren we een algoritme welke ongelijkheid wel kan en welke ongelijkheid ‘discriminatie’ is? Volgende week verschijnt deel 2 uit de blogreeks, waarin ik antwoord zal geven op deze vragen.

Bronnen

1 The International Statistical Institute, “The Oxford Dictionary of Statistical Terms”, edited by Yadolah Dodge, Oxford University Press, 2003.